Linda今天來到了位於台北101大樓77樓的台灣Google總部,Google請來了YouTube的工程研發副總裁Cristos Goodrow、YouTube軟體工程師Jim Mcfadden,以及YouTube大中華與紐澳技術管理負責人葉佳威,要來向大家講解,要怎麼利用機器學習來分辨影片的內容?又要怎麼推薦各自最想看的內容給閱聽人?

演講內容中表示,YouTube的影響力與日俱增,每分鐘有500小時的影片被上傳到YouTube,而YouTube的每日觀看次數至今年已經躍升至10億小時,其威力可見一斑。但同時也因為資料規模龐大、內容不斷地被更新、內容都含有大量雜訊的狀況下,要快速、準確地分析這些數據成了格外困難的事。因此,從你對影片點的喜歡或不喜歡開始,YouTube工程師設定模型,展開了一連串對機器的教導,讓閱聽人能夠順利看到自己想看的影片內容

首先第一道關卡是「候選生成模型(Candidate Generation Model)」,它能將數百萬個影音資料的範圍縮小到數百個送到你眼前,裡頭的判定項目包括觀看紀錄、搜尋紀錄、人口變項(年齡、性別…)等等;第二道關卡則是「排名模型(Ranking Model)」,將篩選出的百部影片做排行決定推送順序,判定項目包括所在地區、最受歡迎影音、使用者語言、觀看紀錄等等

Cristos和葉佳威都提到,其實在YouTube的演算法中,觀看時長比觀看次數比重重要許多,因為觀看時長代表了觀眾對這部影片的黏著度,如果只看了幾秒便關掉,這就不是他真正想看到的內容。他們發現了時間(早上、下午、晚上...)對影片觀看內容的影響不大,反而是裝置的差異有著重大影響:拿手機看輕鬆的短影音,拿電腦看長片。YouTube不斷更新,便是為了維持閱聽人的觀影新鮮感,對於「個人化」的強調也更加重視

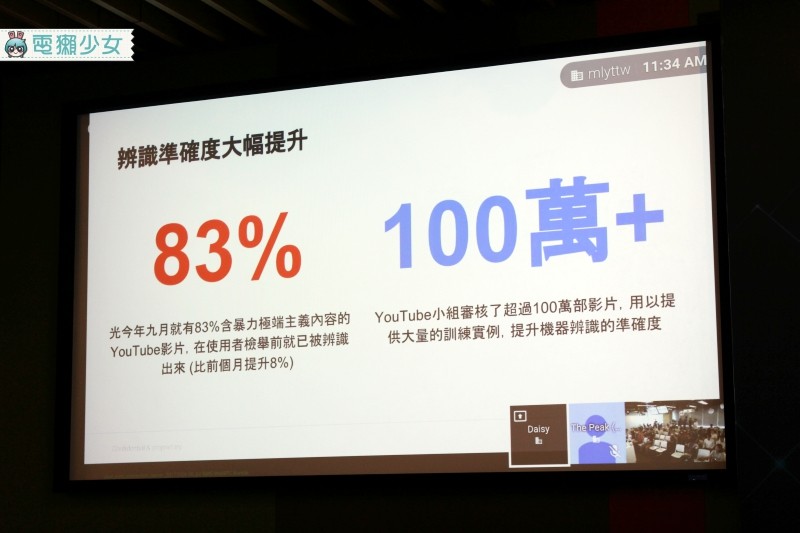

除了利用機器學習推薦影片外,它也能做到一些其他應用,例如分辨恐怖主義、暴力內容等等,目前已有超過八成的暴力影片,在觀眾還未檢舉的狀況下就已遭到下架

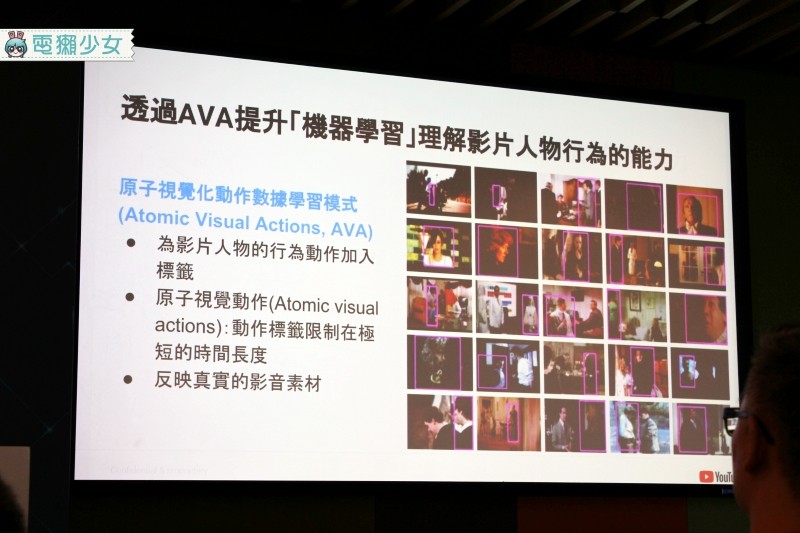

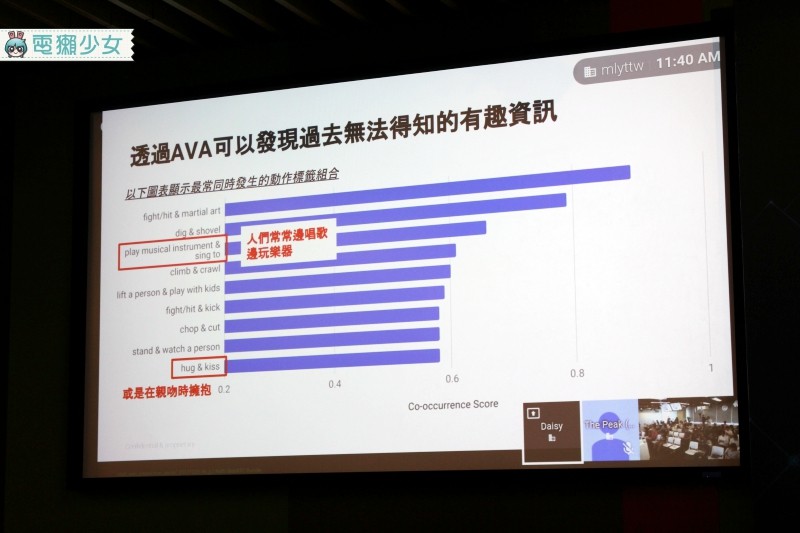

另外,他們不停歇地增加機器學習對於影片中人類行為的辨識,例如辨別裡頭的人在跳舞、唱歌、親吻,也因此,他們得到了一些很有趣的數據,例如在唱歌影片中,絕大部分有伴奏出現,或者在有小孩的影片中,大人多半會把他們抱高高;這些不難猜測,但我們不會直接做連想的內容都是有趣的數據,未來或許可以做到某些利用,例如搜尋「打鼓」可以找到一系列的打鼓影片、突破語言的限制,或是能找到「八零年代哪些電影出現了某種場面」等等,資訊的搜集會更加有效率

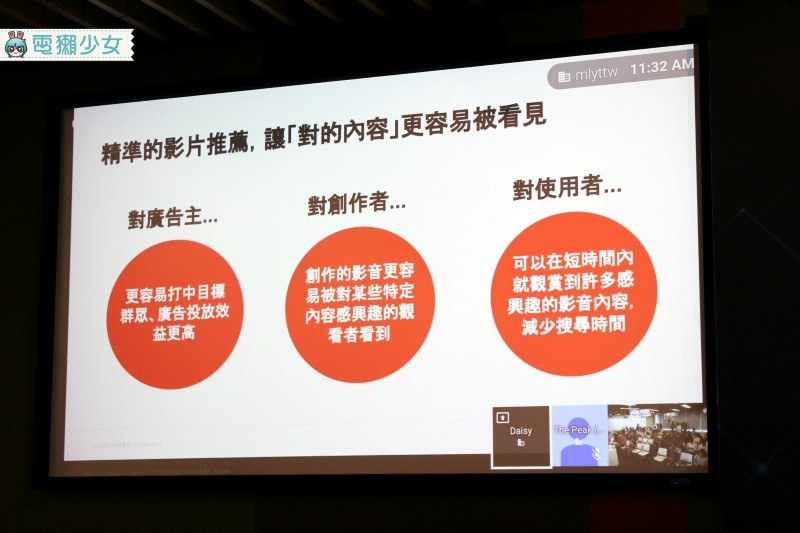

其實推薦內容做得好,不只閱聽人看到喜歡的內容,業者在推送廣告部分也會變得更順利,算是雙贏的局面。Linda一直覺得在這個時代,既然廣告無可避免地進入生活,至少要推薦需要的東西給我吧!而讓我們的使用觀感變好,就是這些YouTube幹部們的主要課題囉。今天的演講內容就總結到這,希望看了文章能讓你有點收獲啦~

獺友募集中!!加入電獺少女LINE@生活圈,每天都有好玩的事情LINE給你哦